특집 ‘특이점’ 4편 — 장벽을 허물 새로운 트리거

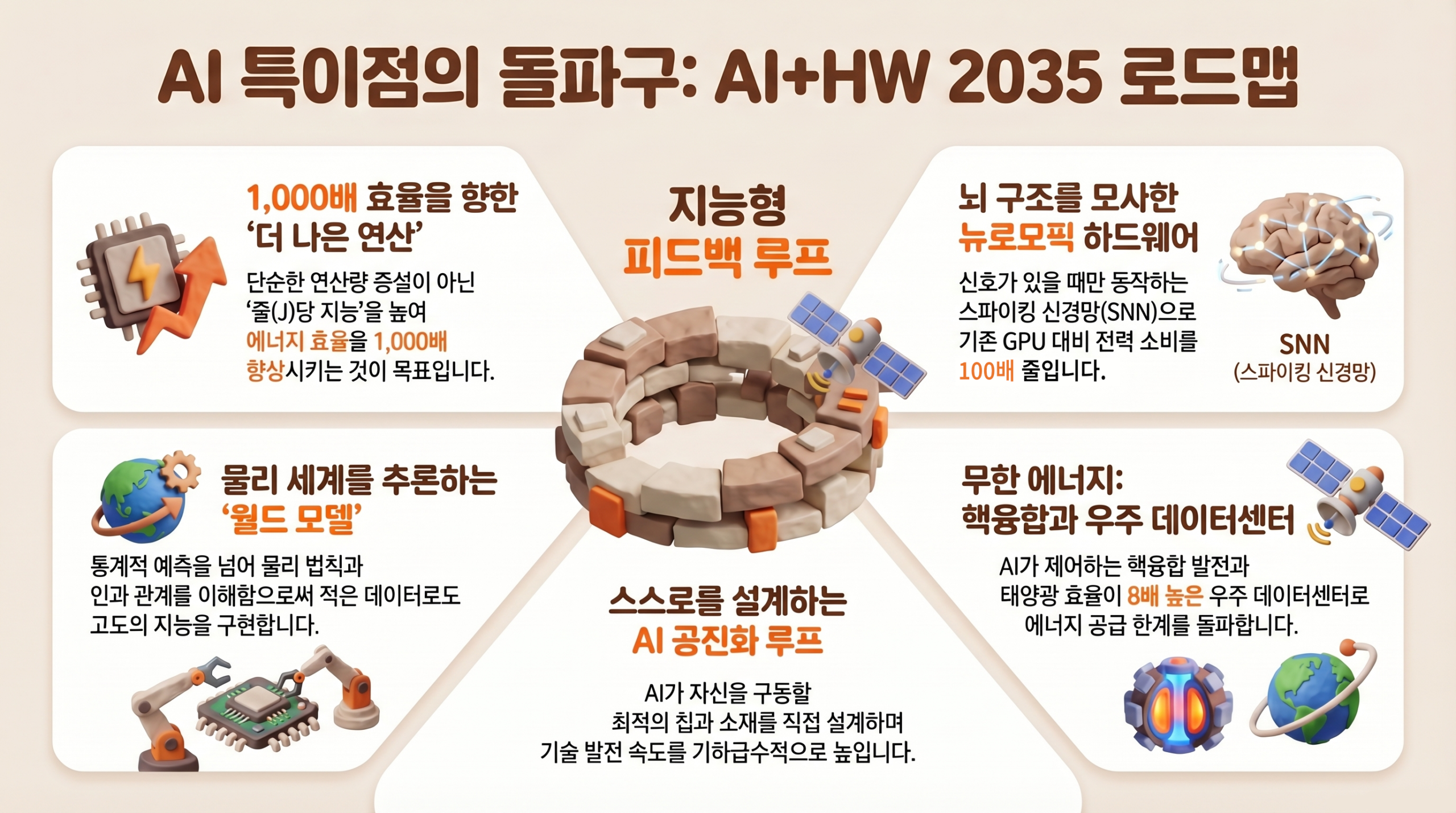

AI+HW 2035 로드맵과 미래 기술이 제시하는 한계 극복의 경로

월드 모델 · 메모리-컴퓨팅 통합 · 뉴로모픽 · 초전도 소재 · 핵융합 · 카르다쇼프 척도 · AI+HW 공진화

지난 3편에서는 현재의 AI가 직면한 뼈아픈 한계들 — ‘월드 모델’의 부재, 지구 전력망의 물리적 한계, 그리고 데이터 고갈로 인한 모델 붕괴의 위험 — 을 살펴보았습니다. 이러한 장벽들만 바라보면 특이점은 영원히 닿을 수 없는 신기루처럼 느껴집니다.

그러나 기술의 역사를 조금만 되짚어보면, 인류는 거대한 물리적·구조적 한계에 부딪힐 때마다 항상 전혀 새로운 패러다임의 기술을 발명해 그 벽을 부수어 왔습니다. 증기기관이 인간의 근력 한계를 돌파했고, 전기가 광원의 한계를 허물었으며, 트랜지스터가 진공관의 벽을 넘어섰습니다. 장벽은 종착점이 아니라 새로운 도약의 디딤돌이었습니다.

이번 4편에서는 최근 발표된 학계·산업계의 10년 로드맵과 현재 진행 중인 미래 기술들을 함께 살펴봅니다. 회의론자들이 지목한 한계들을 정면으로 겨냥하는 연구들이 어디까지 와 있는지, 그리고 이 기술들이 단독으로 작동하는 것이 아니라 서로를 가속하는 피드백 루프를 형성하고 있음을 확인하겠습니다.

1부 · AI+HW 2035

학계와 산업계가 합의한 10년 로드맵 — ‘더 많은 연산’이 아닌 ‘더 나은 연산’

2026년 3월, AI와 하드웨어 분야의 전문가 30인이 공동으로 작성한 비전 논문 하나가 arXiv에 공개됐습니다. ‘AI+HW 2035: Shaping the Next Decade’ — 일리노이대(UIUC), UCLA, 스탠퍼드, 구글, 엔비디아, AMD, IBM, OpenAI, SK하이닉스의 연구자들이 참여했으며, 저자 중에는 3편에서 만났던 얀 르쿤(Yann LeCun)도 이름을 올렸습니다.

이 논문의 출발점은 3편에서 살펴본 회의론자들의 문제의식과 정확히 일치합니다. AI의 에너지 발자국은 환경적·경제적으로 이미 지속 불가능한 수준에 달했고, 최전선 모델 하나를 훈련하는 데 수백 가구에 해당하는 에너지가 소모되며, AI 데이터센터들은 국가 단위의 전력을 소비하고 있다는 것.

그러나 논문이 내리는 결론은 ‘특이점은 불가능하다’가 아닙니다. 지금 당장 필요한 것은 **’더 많은 연산’이 아니라 ‘더 나은 연산’**으로의 방향 전환이라는 것입니다.

논문이 제시하는 10년 후 성공의 정의는 단 하나의 숫자로 압축됩니다. AI 훈련과 추론의 효율을 1,000배(1000×) 향상시키는 것. 이것이 가능하다면, 3편에서 살펴본 회의론의 장벽들은 전혀 다른 의미를 갖게 됩니다. 더 많은 에너지가 필요한 것이 아니라, 지금의 에너지로 1,000배 더 많은 것을 할 수 있게 되기 때문입니다.

1편에서 필자가 제시한 ‘전성비(에너지 효율)’ 개념이 바로 이 논문의 핵심 지표와 만나는 지점입니다. 미래 AI의 성공을 측정하는 척도는 플롭스(FLOPs)나 모델 크기가 아니라, **줄당 지능(intelligence per joule)**이어야 한다는 것이 논문의 방향입니다.

어떻게 이것이 가능할까요? 논문은 세 개의 층위가 서로를 강화하는 공진화 구조를 제시합니다. 이 구조를 따라가면서, 현재 진행 중인 구체적인 기술들을 함께 살펴보겠습니다.

2부 · 하드웨어 층위

연산의 물리학을 다시 쓰다 — ‘메모리 벽’을 허무는 새로운 아키텍처들

3편에서 팀 데트머스는 “선형적 성능 향상을 위해 지수적 자원이 필요하다”고 경고했습니다. 이 경고가 정확히 가리키는 문제가 있습니다. 오늘날 AI 시스템에서 데이터를 이동시키는 데 소모되는 에너지가 실제 연산에 소모되는 에너지보다 많다는 사실입니다. AI+HW 2035 논문은 이것을 ‘메모리 벽(Memory Wall)’이라고 부릅니다. GPU는 연산은 빠르지만, 모델 가중치를 계속해서 별도의 메모리에서 꺼내 오는 데 막대한 에너지를 낭비합니다.

논문은 이 구조 자체를 뒤집는 기술들을 핵심 돌파구로 제시합니다.

컴퓨팅-인-메모리(Compute-in-Memory, CIM). 데이터를 꺼내서 연산하는 것이 아니라, 데이터가 있는 곳에서 바로 연산하는 방식입니다. 저항성 메모리(RRAM) 등 신소재를 활용한 아날로그 AI 가속기가 이 접근법의 핵심입니다. 데이터 이동 비용을 원천적으로 없앰으로써 에너지 효율을 수십 배 이상 높일 수 있습니다.

3D 모노리식 집적(Dense 3D Monolithic Integration). 연산 회로, 메모리, 연결망을 수직으로 쌓아 하나의 칩 안에 통합하는 방식입니다. 데이터가 이동해야 하는 물리적 거리 자체를 극적으로 줄입니다. SK하이닉스를 포함한 메모리 기업들이 이 분야에 집중적으로 투자하고 있는 것은 우연이 아닙니다.

광자(Photonic) 인터커넥트. 전자 신호 대신 빛으로 데이터를 전송하는 방식입니다. 빛은 전자보다 빠르고, 열을 덜 발생시키며, 대역폭이 훨씬 넓습니다. 초대형 AI 클러스터 내부의 칩 간 통신을 광자로 대체하면 지금의 에너지 손실을 획기적으로 줄일 수 있습니다.

양자-고전 하이브리드 시스템. 논문은 양자 프로세서와 기존 AI 파이프라인을 통합하는 하이브리드 아키텍처를 중장기 방향으로 제시합니다. 양자 컴퓨팅은 특정 최적화 및 시뮬레이션 문제에서 고전 컴퓨팅이 근본적으로 도달할 수 없는 영역의 해답을 제공할 수 있습니다.

뉴로모픽 컴퓨팅 — 두뇌를 실리콘에 새기다

이 기술들과 같은 방향에서, 인간의 뇌 구조를 하드웨어 수준에서 모방한 뉴로모픽(Neuromorphic) 컴퓨팅도 빠르게 부상하고 있습니다.

인간의 뇌는 약 20와트(W)의 전력으로 현존하는 가장 복잡한 인지 작업을 수행합니다. 반면 대형 AI 모델 훈련에는 도시 하나의 전력이 필요합니다. 뉴로모픽 칩은 이 격차를 좁히기 위해 뇌의 핵심 원리를 모방합니다. 기존 GPU가 항상 풀가동하는 방식이라면, 뉴로모픽 칩은 뇌의 뉴런처럼 신호가 있을 때만 동작하는 ‘스파이킹 신경망(Spiking Neural Network)’ 방식을 사용합니다. 이 ‘필요할 때만 켜지는’ 구조가 에너지 소비를 극적으로 줄입니다.

현재까지의 성과는 주목할 만합니다. 인텔의 로이히 2(Loihi 2) 기반 시스템 ‘할라 포인트(Hala Point)’는 11억 5천만 개의 뉴런을 모사하며, 특정 AI 추론 작업에서 GPU 대비 최대 100배 낮은 전력 소비를 달성했습니다. 2025년 4월에는 뉴로모픽 하드웨어에서 최초로 LLM을 구동하는 데 성공했습니다. IBM의 노스폴(NorthPole) 칩은 기존 아키텍처 대비 훨씬 낮은 에너지로 다양한 AI 과제를 수행해 2023년 Science지의 주목을 받았습니다.

아직 대형 모델 훈련에서 GPU를 전면 대체할 단계는 아니지만, 엣지(edge) 추론과 로봇공학 등 특화 영역에서는 이미 의미 있는 우위를 보이고 있으며, 2025년 벤처 투자 규모도 전년 대비 세 배로 증가했습니다.

초전도 소재와 그래핀 — AI가 소재를 발명하다

데이터센터의 전력 손실 중 상당 부분은 전기 저항에서 비롯됩니다. 전기 저항이 사실상 ‘0’이 되는 초전도 현상을 상온에서 구현할 수 있다면, 데이터센터의 에너지 손실은 이론적으로 제로에 가까워집니다.

지금까지 초전도는 절대 영도에 가까운 극저온에서만 실현 가능했습니다. 그러나 AI가 이 연구의 속도를 바꾸고 있습니다. 딥마인드의 AlphaFold가 단백질 구조 예측 문제를 해결했듯, 유사한 AI 접근법이 초전도 물질과 그래핀(Graphene) 기반 신소재 탐색에 적용되고 있습니다. 방대한 소재 공간을 고속으로 시뮬레이션하여, 기존에는 수십 년이 걸렸을 소재 발견 과정을 수년 혹은 수개월로 단축하는 것이 목표입니다.

AI가 자신을 더 효율적으로 구동할 하드웨어 소재를 스스로 발명하는 구조 — 이것이 현실이 되는 순간, 3편에서 제기된 물리적 한계론은 전혀 다른 의미를 갖게 됩니다.

이 모든 하드웨어 기술들의 공통점은 하나입니다. 더 많은 에너지를 투입하는 것이 아니라, 지금의 에너지로 훨씬 더 많은 일을 하도록 구조 자체를 바꾸는 것입니다.

3부 · 알고리즘 층위

AI가 스스로의 하드웨어를 설계한다 — 알고리즘과 하드웨어의 공진화

AI+HW 2035 논문이 가장 강조하는 것은 알고리즘과 하드웨어가 따로 발전하는 오늘날의 구조적 문제입니다. 오늘의 알고리즘은 어제의 시스템에 맞춰 설계되고, 내일의 칩은 오늘의 워크로드에 최적화됩니다. AI는 수개월 단위로 발전하는데, 하드웨어는 수년 단위로 진화합니다. 이 시차가 시스템 전체의 비효율을 복리로 키웁니다.

논문이 제시하는 해법은 **’AI-in-the-loop 설계’**입니다. AI가 하드웨어 설계 과정 자체에 투입되어, 회로 탐색부터 코드 생성, 검증, 합성까지 자동화하는 구조입니다. AI가 자신을 가동할 더 좋은 칩을 스스로 설계하는 피드백 루프가 현실화되고 있습니다.

월드 모델 — 통계에서 물리 법칙으로

알고리즘 층위에서 가장 주목해야 할 것은 물리 세계를 이해하는 AI입니다.

3편에서 살펴본 것처럼, 튜링상 수상자 얀 르쿤은 현재의 LLM이 ‘통계적 앵무새’에 불과하다는 문제의식 하에 메타를 떠나 AMI Labs(Advanced Machine Intelligence Labs)를 창업했습니다. 2026년 3월, AMI Labs는 유럽 역사상 최대 규모의 시드 라운드인 10억 3천만 달러(약 1조 4천억 원)의 투자를 유치했습니다. 엔비디아, 토요타, 삼성은 물론 제프 베이조스와 에릭 슈미트도 개인 투자자로 참여했습니다.

AMI Labs의 핵심 기술은 르쿤이 2022년부터 개발해 온 **JEPA(Joint Embedding Predictive Architecture)**입니다. 기존 LLM이 텍스트의 다음 단어를 예측하는 방식이라면, JEPA는 영상과 센서 데이터로부터 세계의 추상적 표현을 학습합니다. 다음에 무슨 일이 일어날지 모든 세부 사항을 예측하려 들지 않고, 세계를 구조적으로 표현하는 잠재 공간(latent space)을 학습합니다. AI+HW 2035 논문의 표현을 빌리면, 이것은 “데이터를 피팅하는 것이 아니라 물리적 과정을 추론하는 AI 시스템”을 향한 방향 전환입니다.

같은 방향을 향한 경쟁도 치열합니다. AI 분야의 선구자 페이페이 리(Fei-Fei Li)가 설립한 World Labs 역시 10억 달러를 유치했고, 구글 딥마인드(Google DeepMind)도 독자적인 월드 모델 연구를 병행하고 있습니다.

뉴로심볼릭 AI — 통계와 논리의 결합

월드 모델과 병행하여 주목받는 또 다른 접근법이 있습니다. **뉴로심볼릭 AI(Neurosymbolic AI)**는 딥러닝의 통계적 패턴 인식 능력에 인간의 논리적 추론 규칙을 결합한 혼합 아키텍처입니다. LLM이 취약한 인과 추론과 체계적 일반화 능력을 크게 향상시킬 수 있다고 연구자들은 기대합니다. 방대한 전력과 데이터에 의존하는 ‘무식한 스케일링’의 한계를 벗어나, 보다 적은 자원으로 더 높은 수준의 추론을 달성하는 것이 이 연구의 목표입니다.

다만 이 기술들 모두에 대해 르쿤 본인이 솔직하게 인정하듯, “LLM이 아닌 방식으로 인간 수준의 AI를 달성하는 데는 아직 중요한 개념적 돌파구들이 필요하며, 내년이나 내후년의 일이 아닙니다.” 월드 모델과 뉴로심볼릭 AI는 현재 ‘유망한 연구 단계’이지, 아직 완성된 해법이 아닙니다. 회의론자들이 지적한 한계를 넘어서기 위한 길은 열려 있지만, 그 길이 짧지는 않습니다.

4부 · 에너지의 지평선

카르다쇼프 척도와 우주적 확장 — 지구의 에너지를 온전히 쓰고, 그다음엔 별을 향해

AI+HW 2035 논문은 하드웨어와 알고리즘의 효율 향상만으로는 충분하지 않다는 점도 명시합니다. 에너지 자체를 근본적으로 다른 방식으로 확보하는 공급 측 혁신이 병행되어야 합니다.

이 문제를 거시적으로 바라보는 좌표계가 있습니다. 소련 천문학자 니콜라이 카르다쇼프가 1964년 제안한 **카르다쇼프 척도(Kardashev Scale)**는 문명의 기술 수준을 에너지 활용량으로 측정합니다. 1단계 문명은 행성의 에너지를 100% 활용하는 수준, 2단계 문명은 항성 에너지 전체를 활용하는 수준입니다.

네이처 계열 저널 Scientific Reports에 2023년 게재된 머신러닝 기반 분석 논문에 따르면, 인류의 현재 위치는 0.7276단계입니다. 지구에 도달하는 태양 에너지의 극히 일부만을 활용하고 있다는 뜻입니다. 현재 추세가 이어진다면 2060년에는 0.7449단계에 이를 것으로 전망됩니다. 이것은 암울한 수치가 아니라, 반대로 이야기하면 아직 활용하지 않은 거대한 에너지 저장소가 우리 발밑에, 그리고 머리 위에 있다는 의미이기도 합니다.

AI가 자신의 에너지를 설계한다 — 핵융합과의 만남

가장 극적인 에너지 공급 혁신은 AI와 핵융합의 결합에서 나오고 있습니다.

핵융합 반응에서 가장 어려운 과제는 수억 도에 달하는 초고온 플라즈마를 안정적으로 유지하는 일입니다. 이 플라즈마는 본질적으로 불안정하여, 자기 코일의 전압을 매초 수천 번 조정해야만 합니다. 인간의 반응 속도로는 불가능한 과제입니다. 2022년, 구글 딥마인드는 스위스 플라즈마 센터(EPFL)와 공동으로 심층 강화학습 AI를 이용해 실제 토카막 장치에서 플라즈마를 성공적으로 제어하는 데 세계 최초로 성공했고, 이 결과는 네이처(Nature)지에 게재되었습니다.

2025년 10월, 딥마인드는 민간 핵융합 기업 Commonwealth Fusion Systems(CFS)와 파트너십을 체결하고, AI 플라즈마 시뮬레이터 ‘TORAX’를 차세대 핵융합 장치 ‘SPARC’ 개발에 투입하고 있습니다. 구글은 CFS가 2030년대 초 가동을 목표로 하는 첫 번째 핵융합 발전소 ‘ARC’에서 200메가와트(MW)의 전력을 구매하는 계약까지 체결했습니다.

AI가 자신을 가동할 에너지원을 설계하는 피드백 루프 — 이것이 현실이 되고 있습니다.

우주로 나가는 데이터센터

지구의 에너지 한계를 가장 급진적인 방식으로 돌파하려는 시도도 이미 현실에서 진행 중입니다.

2025년 11월, 구글은 **’프로젝트 선캐처(Project Suncatcher)’**를 공개했습니다. AI 연산에 특화된 TPU 칩을 탑재한 위성 군집을 저궤도에 올려 태양광으로 구동하는 우주 데이터센터를 건설하겠다는 계획으로, 2027년 시험 위성 2기 발사를 첫 목표로 잡았습니다. 구글에 따르면, 구름도 대기도 밤도 없는 적절한 궤도에서 태양광 패널은 지상 대비 최대 여덟 배의 연간 에너지를 생산할 수 있으며, 우주의 극저온 환경이 막대한 비용이 드는 서버 냉각 문제를 자연적으로 해결해 줍니다.

스타트업 Starcloud는 2025년 이미 궤도에서 최초로 LLM 훈련을 수행했고, 스페이스엑스(SpaceX)는 2026년 1월 최대 100만 기의 위성으로 이루어진 궤도 데이터센터 계획을 FCC에 제출했습니다. 엔비디아도 2026년 3월 ‘스페이스-1’ 플랫폼을 발표하며 우주 컴퓨팅 시장에 참여를 선언했습니다.

물론 이것이 가까운 미래의 현실이 되려면 과제가 남아 있습니다. 구글의 분석에 따르면 우주 데이터센터의 경제성은 발사 비용이 킬로그램당 200달러 수준으로 떨어지는 2035년경에야 확보될 것으로 전망됩니다. 현재 발사 비용은 킬로그램당 약 1,500~2,900달러 수준입니다. 프로젝트 선캐처는 구글이 스스로 ‘문샷(moonshot)’이라고 명명한 고위험·고보상 프로젝트이며, 2027년 시험 발사가 곧 대규모 우주 데이터센터의 실용화를 의미하지는 않습니다.

5부 · 세 층위의 교차점

피드백 루프가 만드는 가속 — 특이점은 문제를 먹고 자란다

AI+HW 2035 논문의 핵심 통찰은 이 모든 기술들이 독립적으로 발전하는 것이 아니라는 점입니다. 세 개의 층위 — 하드웨어 기술, 알고리즘과 패러다임, 응용과 사회적 영향 — 는 긴밀하게 결합된 동적 피드백 루프를 형성합니다.

하드웨어의 발전이 새로운 알고리즘을 가능하게 하고, 새로운 알고리즘은 하드웨어 설계에 AI를 투입하여 하드웨어의 다음 세대를 앞당깁니다. 이렇게 만들어진 더 강력한 AI는 소재 탐색을 가속하고, 더 나은 소재는 에너지 효율을 높이며, 높아진 효율은 더 야심찬 AI 훈련을 가능하게 합니다.

일론 머스크는 다가올 AI와 로보틱스의 진화를 이렇게 설명합니다. 세 가지 지수 함수 — AI 소프트웨어의 기하급수적 성장, AI 칩 능력의 기하급수적 성장, 기계적 손재주의 기하급수적 성장 — 가 곱해지는 융합의 결과라고 말이죠. 여기에 로봇이 로봇을 설계하고 제조하는 재귀적 효과가 결합되면, 발전 속도는 우리의 예측을 아득히 초월하게 됩니다.

논문이 제시하는 2035년의 성공 기준을 정리하면 이렇습니다. AI 훈련과 추론의 효율을 현재 대비 1,000배 향상시킨다. 클라우드, 엣지, 물리적 AI 환경을 끊김 없이 가로지르는 에너지 인식형·자기 최적화 시스템을 구현한다. 첨단 AI 인프라에 대한 접근을 민주화한다 — 소수의 대형 빅테크만이 프런티어 AI를 다룰 수 있는 구조에서 벗어나야 한다는 의미입니다. 그리고 인간 중심의 원칙을 지능형 시스템 설계에 내재화한다.

결론: 장벽이 트리거가 되는 역설

회의론자들의 지적은 틀리지 않았습니다. 월드 모델의 부재, 에너지 고갈, 컴퓨팅 파워의 한계 — 이것들은 현재 기술 패러다임이 실제로 직면한 구조적 도전들입니다.

그러나 역설적으로, 바로 이 거대한 문제들이 AI+HW 2035 같은 범학계적 10년 로드맵, AMI Labs의 월드 모델 연구, 딥마인드와 핵융합 기업들의 협력, 구글의 우주 데이터센터 계획, 뉴로모픽 컴퓨팅과 초전도 소재 연구에 대한 투자의 폭발적 증가를 촉발시키고 있습니다. 장벽이 트리거가 되고 있는 것입니다.

물론 이 모든 기술들은 아직 완성되지 않았습니다. 월드 모델은 여전히 근본적인 개념적 돌파구를 필요로 하고, 우주 데이터센터는 2035년 이전에 경제성을 확보하기 어려우며, 상온 초전도는 아직 실험실 수준에 머물러 있습니다. 회의론자들의 경고는 여전히 유효합니다.

그러나 동시에 이것이 중요합니다. 이 기술들은 단순한 공상이 아니라, 지금 이 순간 실제 자본과 실제 연구자들이 투입된 실험실에서 진행 중인 프로젝트들입니다. 그리고 역사는 지금 우리가 ‘불가능하다’고 생각하는 것들이 어떻게 어느 날 갑자기 ‘당연한 것’이 되는지를 반복해서 보여주었습니다.

인류가 에너지와 하드웨어의 물리적 병목을 해결하는 그 순간, 특이점을 향한 카운트다운은 멈추는 것이 아니라 상상조차 하기 어려운 속도로 다시 폭발할 것입니다.

다음 편 예고 — 5편

그렇다면 낙관론의 비전과 회의론의 경고, 그리고 그것을 뛰어넘으려는 기술들이 교차하는 이 거대한 전환기 속에서 우리 **’인간’**은 어떻게 생존하고 어떤 가치를 추구해야 할까요? 다음 5편에서는 특이점 시대를 맞이하는 개인이 갖춰야 할 필수 역량과, 노동의 의미가 근본적으로 흔들리는 시대에 새롭게 대두될 인간 고유의 가치에 대한 철학적·실천적 생존 전략을 다루어 보겠습니다.

참고자료 및 출처

- Deming Chen et al., “AI+HW 2035: Shaping the Next Decade”, arXiv:2603.05225 (2026.03.05) — UIUC, UCLA, Stanford, Google, NVIDIA, AMD, IBM, OpenAI, SK Hynix 등 30인 공동 저술

- AMI Labs / Yann LeCun, TechCrunch 보도 (2026.03) — 10억 3천만 달러 투자, JEPA 기반 월드 모델 연구; 투자자: NVIDIA, Toyota, Samsung, Jeff Bezos, Eric Schmidt 등

- Yann LeCun, MIT Technology Review 인터뷰 (2026.01.22) — AMI Labs와 월드 모델 비전

- Google DeepMind, “Accelerating Fusion Science through Learned Plasma Control”, Nature (2022.02) 및 Commonwealth Fusion Systems 파트너십 발표 (2025.10)

- Google, “Project Suncatcher” 연구 논문 발표 (2025.11) — Semafor, Scientific American 보도

- Starcloud, White Paper: “Why we should train AI in Space” (2024.09) — 2025년 최초 궤도 LLM 훈련 성공

- SpaceX, FCC 궤도 데이터센터 신청 (2026.01)

- NVIDIA, Space-1 플랫폼 발표 (2026.03)

- Scientific Reports, “Forecasting the progression of human civilization on the Kardashev Scale through 2060 with a machine learning approach” (2023) — 인류 현재 위치 0.7276단계

- PNAS, “Can neuromorphic computing help reduce AI’s high energy cost?” (2025.11) — Intel Hala Point, IBM NorthPole 관련

- IBM NorthPole, Science지 게재 (2023.10) — 에너지 효율 향상 논문