로컬 AI의 심장: Ollama & 최신 Gemma4 설치법

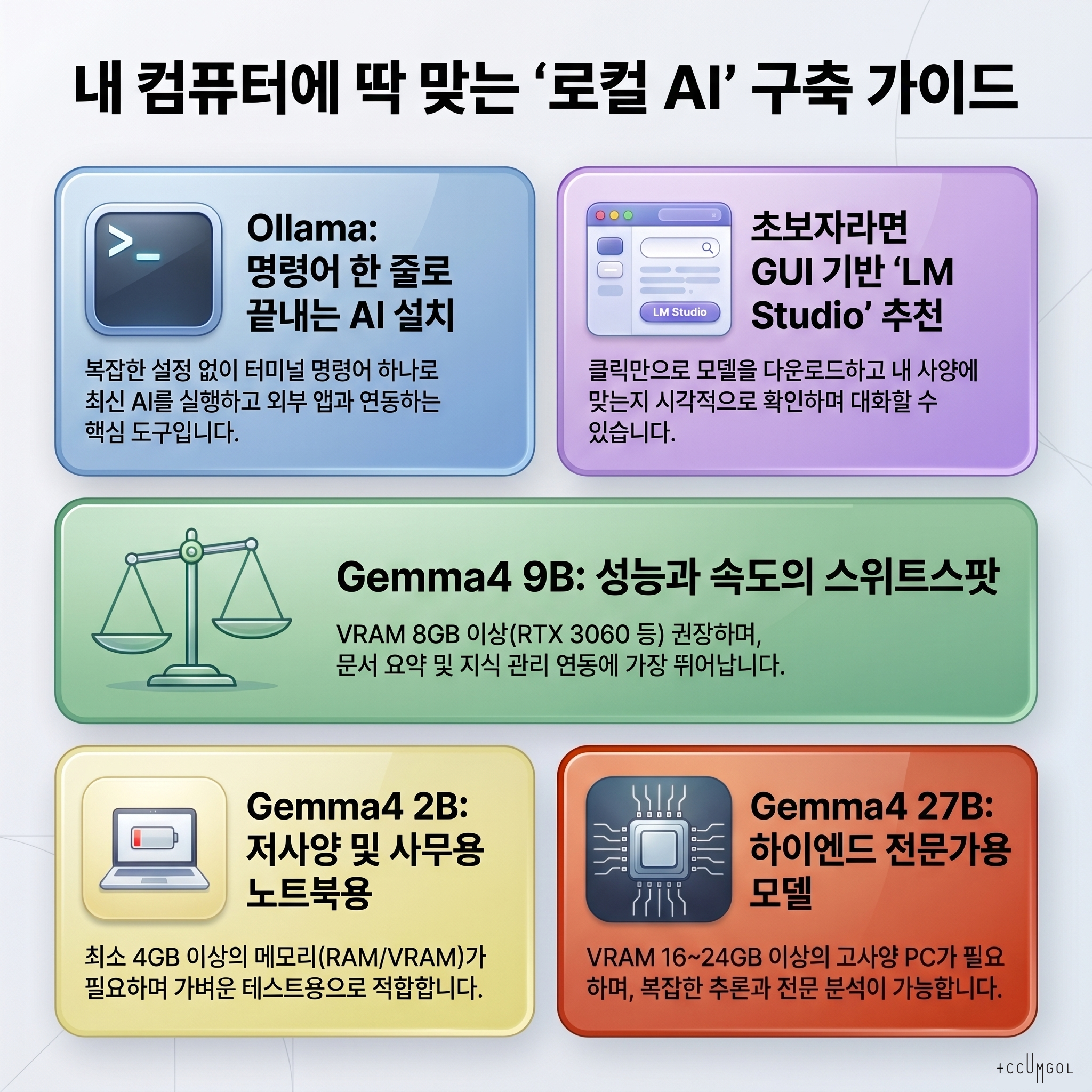

앞선 매뉴얼에서 우리는 ‘나만의 자동 위키’를 만들기 위해 Ollama와 Gemma4를 사용했습니다. 그렇다면 이 도구들은 정확히 무엇이고, 내 컴퓨터 사양에 맞는 모델은 어떻게 골라야 할까요?

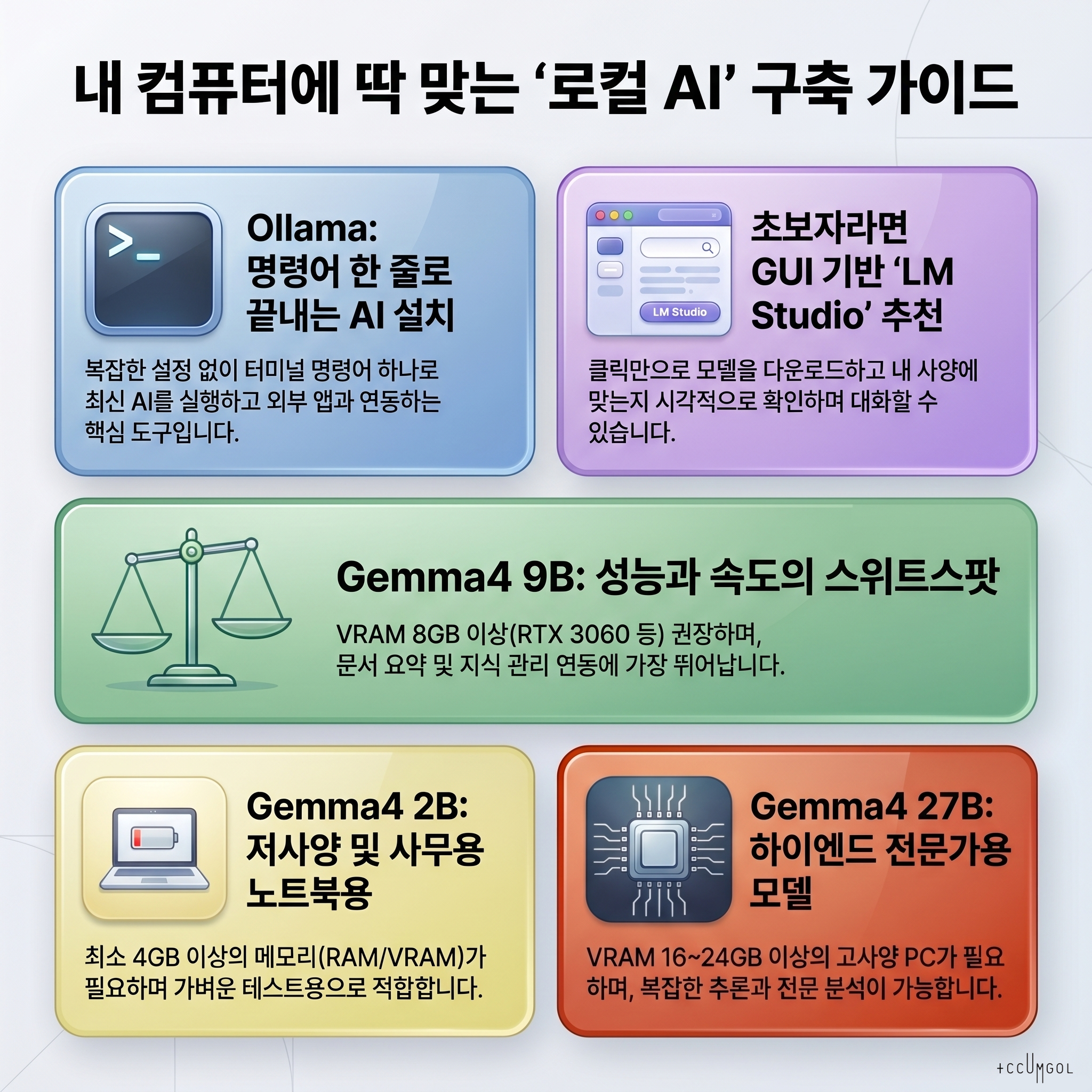

이 문서에서는 로컬 AI 구동의 핵심인 Ollama와 그 대체재들, 그리고 뛰어난 성능을 자랑하는 Gemma4 모델의 버전별 하드웨어 스펙을 아주 알기 쉽게 정리해 드립니다.

1. 🦙 Ollama란 무엇인가요?

- *Ollama(올라마)**는 복잡한 파이썬(Python) 코드나 개발 환경 세팅 없이, 클릭 몇 번과 명령어 한 줄로 내 컴퓨터에서 최신 AI(LLM)를 구동하게 해주는 마법 같은 프로그램입니다.

- 특징: 마치 앱스토어에서 앱을 다운받듯,

ollama run gemma4라는 짧은 명령어 하나만 입력하면 모델 다운로드부터 실행까지 알아서 처리해 줍니다. - 장점: 백그라운드에서 매우 가볍게 돌아가며, Obsidian과 같은 외부 프로그램(플러그인)과 통신하기 위한 API를 기본적으로 제공하기 때문에 연동성이 가장 뛰어납니다.

🔄 Ollama와 동일한 기능을 하는 타 서비스 (대체재)

Ollama 외에도 로컬에서 AI를 돌릴 수 있는 훌륭한 프로그램들이 있습니다. 본인의 취향에 따라 선택해 보세요.

- LM Studio (가장 추천하는 대체재)

- 특징: 까만 터미널 화면(명령어 창)이 무서운 분들을 위한 최고의 그래픽(GUI) 기반 프로그램입니다.

- 장점: 챗GPT와 똑같이 생긴 깔끔한 채팅창을 제공하며, 모델을 검색하고 다운로드하는 과정이 마우스 클릭만으로 이루어집니다. 어떤 모델이 내 컴퓨터 메모리(RAM/VRAM)에 맞는지 초록색, 빨간색 선으로 친절하게 알려줍니다.

- GPT4All

- 특징: GPU(그래픽카드)가 없고 성능이 낮은 일반 사무용 노트북(CPU 기반)에서도 AI를 꽤 잘 돌아가게 만들어주는 데 특화된 프로그램입니다.

- 장점: 프라이버시를 극도로 강조하며, 개인 문서를 읽게 하는 기능(Local Docs)이 프로그램 자체에 내장되어 있습니다.

- text-generation-webui (Oobabooga)

- 특징: 로컬 AI계의 ‘스위스 아미 나이프’로 불리는 전문가용 툴입니다.

- 장점: 모델의 성격을 바꾸거나 미세조정(파인튜닝)을 하는 등 아주 세밀한 설정이 가능하지만, 초보자에게는 메뉴가 너무 많아 복잡할 수 있습니다.

2. 💎 구글의 최신 오픈소스 AI, Gemma4

Gemma(젬마) 시리즈는 구글(Google)이 자사의 초거대 AI인 제미나이(Gemini)를 만들 때 사용한 기술을 바탕으로, 일반인들도 무료로 다운받아 쓸 수 있도록 작게 압축해 공개한 최신 오픈 모델입니다.

최신 Gemma4는 모델의 크기(파라미터 수)에 따라 크게 3가지 체급으로 나뉩니다. 모델이 클수록 더 똑똑하고 말을 잘하지만, 그만큼 내 컴퓨터의 메모리(RAM/VRAM)를 많이 잡아먹습니다.

💡 알아두기 (양자화란?): 원래의 AI 모델은 용량이 너무 커서 일반 컴퓨터에서 돌리기 힘듭니다. 그래서 화질을 살짝 낮춰 용량을 줄인 MP3나 JPEG 파일처럼, AI의 지능은 최대한 유지하면서 용량을 절반 이하로 깎아낸 버전을 **’4-bit 양자화(Quantization, 보통

-int4또는Q4가 붙음)’**라고 부릅니다. 아래 스펙은 이 양자화 버전을 기준으로 설명합니다.

📊 Gemma4 체급별 하드웨어 요구 스펙

| 모델 버전 | 지능 수준 | 추천 용도 | 최소 필요 VRAM (Mac은 RAM) | 권장 하드웨어 스펙 |

| Gemma4 2B

(소형) |

기본적

(간단한 대화 수준) |

구형 노트북이나 내장 그래픽 컴퓨터에서의 가벼운 테스트용 | 4GB 이상 | 일반적인 사무용 노트북, M1/M2 Mac (8GB RAM 모델) |

| Gemma4 9B

⭐**(추천/중형)** |

우수함

(맥락 파악 및 요약 특화) |

Obsidian 자동 위키 연동, 코딩 보조, 긴 문서 요약 등 실사용의 스위트스팟 | 8GB 이상 | NVIDIA RTX 3060 / 4060 이상 (VRAM 8GB), Mac (16GB RAM 모델 이상) |

| Gemma4 27B

(대형) |

매우 뛰어남

(복잡한 추론 가능) |

전문적인 논문 분석, 소설 작성, 복잡한 논리적 문제 해결 등 하이엔드 작업 | 16GB ~ 24GB 이상 | NVIDIA RTX 3090 / 4090 (VRAM 24GB), Mac Studio 또는 Max/Ultra 칩셋 (32~64GB RAM) |

🛠️ 내 컴퓨터에 맞는 Gemma4 선택 가이드

- 1. 일반적인 윈도우 랩탑이나 8GB RAM의 M1/M2 맥북을 쓰신다면: 👉 무조건

Gemma4 2B모델을 선택하세요. 9B를 억지로 돌리면 컴퓨터가 멈추거나 한 글자가 나오는 데 10초씩 걸릴 수 있습니다. - 2. 16GB RAM의 최신 맥북이나, VRAM 8GB 이상의 게이밍 PC(예: RTX 3060/4060)를 쓰신다면: 👉

Gemma4 9B모델이 가장 완벽한 선택입니다. 옵시디언의 자동 위키 시스템이 빠르고 똑똑하게 내 생각을 연결해 줄 수 있는 이상적인 체급입니다. - 3. VRAM 24GB의 하이엔드 그래픽카드(RTX 4090 등)나 64GB 통합 메모리의 Mac Studio를 쓰신다면: 👉 **

Gemma4 27B*를 구동해 보세요. 웬만한 유료 AI 부럽지 않은 날카로운 추론 능력과 방대한 지식을 뽐낼 것입니다.

📌 요약: 로컬 AI 위키 시스템(Obsidian + Ollama)을 처음 구축하시는 거라면, 성능과 속도의 밸런스가 가장 훌륭한

Gemma4 9B모델을 최우선으로 추천해 드립니다!